Hoy os quiero hablar de uno de esos “secretos a voces” que tiene SQL Server. En SQL Server, existen herramientas y comandos que, aunque nadie te va a decir oficialmente que están disponibles, son bien conocidos por los DBAs y pueden ser extremadamente útiles. Uno de estos comandos es DBCC LOG, una funcionalidad que nos permite acceder al contenido del log de transacciones de SQL Server. A lo largo de este artículo, veremos cómo funciona DBCC LOG, sus aplicaciones prácticas y algunas consideraciones que debemos tener en cuenta para utilizarlo eficazmente.

Introducción a DBCC LOG

En SQL Server el log de transacciones es una de las piezas fundamentales del sistema. Este log almacena una secuencia de todas las modificaciones realizadas en la base de datos, lo que nos permite, además, la recuperación de datos en caso de fallos y la replicación en entornos distribuidos. A través del comando DBCC LOG, podemos acceder directamente a este registro, algo que puede ser especialmente valioso en escenarios de depuración o análisis forense de la base de datos.

Sin embargo, a diferencia de otros comandos de la familia DBCC (Database Console Commands), DBCC LOG no está documentado oficialmente por Microsoft, lo que significa que su uso conlleva ciertos riesgos y limitaciones. No obstante, para aquellos de nosotros que manejamos SQL Server en profundidad, esta herramienta puede ofrecer una visión muy valiosa de lo que ocurre “bajo el capó” de nuestra base de datos.

¿Cómo funciona DBCC LOG?

El comando DBCC LOG nos permite visualizar el contenido del log de transacciones de una base de datos específica. Así, al ejecutar este comando, obtendremos una salida que incluye cada una de las entradas de este registro, desde operaciones de inserción, eliminación y actualización hasta transacciones de nivel más bajo como asignaciones de páginas o cambios en la estructura de las tablas.

La sintaxis básica para ejecutar DBCC LOG es la siguiente:

DBCC LOG ([NombreBaseDeDatos], [TipoDeSalida])Como veis, el comando necesita de los parametros que yo he llamado NombreBaseDeDatos que es el nombre de la base de datos cuyo log queremos inspeccionar, y, del parametro TipoDeSalida que tiene que ser un número entre 0 y 4 que determina el nivel de detalle de la información que recibimos. Este segundo parámetro es crucial, ya que permite ajustar la cantidad y el tipo de datos que se devuelven, desde un resumen básico hasta una vista muy detallada de las operaciones.

Es importante entender que la salida generada por DBCC LOG puede ser extensa y, en muchos casos, poco intuitiva. No es un comando que se utilice habitualmente para tareas diarias, sino más bien en situaciones específicas donde necesitamos conocer el estado exacto de las transacciones en un momento dado.

¿Qué información nos devuelve?

La salida de DBCC LOG varía en función del parametro de tipo de salida que elijamos. Así, tendremos distintos niveles de detalle de más a menos entre 0 y 3 y todo el detalle con el parámetro 4 (igual que el 3) pero en este caso recogido en un volcado hexadecimal.

DBCC LOG(‘basededatos’,0)

- Current LSN

- Operation

- Context

- TransactionID

- LogBlockGeneration

DBCC LOG(‘basededatos’,1)

- Current LSN

- Operation

- Context

- TransactionID

- LogBlockGeneration

- TagBits

- Log Record Fixed Length

- Log Record Length

- Previous LSN

- Flag Bits

- Log Reserve

- Description

DBCC LOG(‘basededatos’,2)

- Current LSN

- Operation

- Context

- Transaction ID

- LogBlockGeneration

- Tag Bits

- Log Record

- Fixed Length

- Log Record Length

- Previous LSN

- Flag Bits

- Log Reserve

- AllocUnitId

- AllocUnitName

- Page ID

- Slot ID

- Previous Page LSN

- Number of Locks

- Lock Information

- Description

DBCC LOG(‘basededatos’,3)

- Current LSN

- Operation

- Context

- Transaction ID

- LogBlockGeneration

- Tag Bits

- Log Record Fixed Length

- Log Record Length

- Previous LSN

- Flag Bits

- Log Reserve

- AllocUnitId

- AllocUnitName

- Page ID

- Slot ID

- Previous Page LSN

- PartitionId

- RowFlags

- Num Elements

- Offset in Row

- Modify Size

- Checkpoint Begin

- CHKPT Begin DB Version

- Max XDESID

- Num Transactions

- Checkpoint End

- CHKPT End DB Version

- Minimum LSN Dirty Pages

- Oldest Replicated Begin LSN

- Next Replicated End LSN

- Last Distributed Backup End LSN

- Last Distributed End LSN

- Repl Min Hold LSN

- Server UID

- SPID

- Beginlog Status

- Xact Type

- Begin Time

- Transaction Name

- Transaction SID

- Parent Transaction ID

- Oldest Active Transaction ID

- Xact ID

- Xact Node ID

- Xact Node Local ID

- End AGE

- End Time

- Transaction Begin

- Replicated Records

- Oldest Active LSN

- Server Name

- Database Name

- Mark Name

- Master XDESID

- Master DBID

- Preplog Begin LSN

- Prepare Time Virtual Clock

- Previous Savepoint

- Savepoint Name

- Rowbits First Bit

- Rowbits Bit Count

- Rowbits Bit Value

- Number of Locks

- Lock Information

- LSN before writes

- Pages Written Command Type

- Publication ID

- Article ID

- Partial Status

- Command

- Byte Offset

- New Value

- Old Value

- New Split Page

- Rows Deleted Bytes Freed

- CI Table Id

- CI Index Id

- NewAllocUnitId

- FileGroup ID

- Meta Status

- File Status

- File ID

- Physical Name

- Logical Name Format LSN

- RowsetId

- TextPtr Column Offset Flags

- Text Size

- Offset Old Size

- New Size

- Description

- Bulk allocated extent count

- Bulk RowsetId Bulk AllocUnitId

- Bulk allocation first IAM Page ID

- Bulk allocated extent ids

- VLFs added

- InvalidateCache Id

- InvalidateCache keys

- CopyVerionInfo Source Page Id

- CopyVerionInfo Source Page LSN

- CopyVerionInfo Source Slot Id

- CopyVerionInfo Source Slot Count

- RowLog Contents 0

- RowLog Contents 1

- RowLog Contents 2

- RowLog Contents 3

- RowLog Contents 4

- RowLog Contents 5

- Compression Log Type

- Compression Info

- PageFormat PageType

- PageFormat PageFlags

- PageFormat PageLevel

- PageFormat PageStat

- PageFormat FormatOption

DBCC LOG(‘basededatos’,4)

- Current LSN

- Operation

- Context

- Transaction ID

- LogBlockGeneration

- Tag Bits

- Log Record Fixed Length

- Log Record Length

- Previous LSN Flag Bits

- Log Reserve

- Description

- Log Record

Aplicaciones Prácticas de DBCC LOG

Una de las aplicaciones más directas de DBCC LOG es la identificación de transacciones específicas que han tenido lugar en la base de datos. Por ejemplo, en un escenario donde necesitamos auditar cambios realizados por un usuario o aplicación, podemos utilizar este comando para rastrear esas modificaciones en el log de transacciones.

Supongamos que necesitamos investigar un problema de corrupción de datos o pérdida de información. Al acceder al log de transacciones con DBCC LOG, podemos reconstruir los pasos previos al incidente y entender qué ocurrió exactamente. Este nivel de análisis es particularmente útil en entornos donde la estabilidad y consistencia de la base de datos son críticas.

Otra aplicación interesante es la optimización del rendimiento. Aunque DBCC LOG no se usa directamente para este fin, entender el log de transacciones puede ayudarnos a identificar patrones de uso que afecten al rendimiento. Por ejemplo, podríamos descubrir que ciertas transacciones están generando un número excesivo de registros, lo que a su vez podría estar ralentizando las operaciones de escritura en la base de datos.

Limitaciones y Consideraciones

Aunque DBCC LOG es una herramienta poderosa, su uso no está exento de limitaciones. La primera de ellas es la falta de documentación oficial, lo que significa que estamos trabajando en un terreno relativamente inexplorado. Es crucial tener cuidado al interpretar los resultados y no hacer suposiciones precipitadas basadas en la salida del comando.

Además, debido a la cantidad de información que puede devolver, es recomendable utilizar DBCC LOG en entornos controlados y con un propósito claro. No es un comando para ejecutarse indiscriminadamente en un entorno de producción sin un motivo justificado, ya que podría generar una gran carga en el sistema y dificultar la interpretación de los datos.

Otro aspecto a considerar es la compatibilidad. A lo largo de las diferentes versiones de SQL Server, la estructura interna del log de transacciones puede cambiar, lo que significa que los resultados de DBCC LOG pueden variar entre versiones. Esto puede complicar la utilización del comando en sistemas donde se utilizan múltiples versiones de SQL Server o donde se planea una migración.

Por último, el uso de procedimientos indocumentados, aunque no supone en sí mismo la pérdida del soporte por parte de Microsoft, este si puede no hacerse cargo si ve que el problema está relacionado con alguno de estos procedimientos.

Dificultad de interpretación

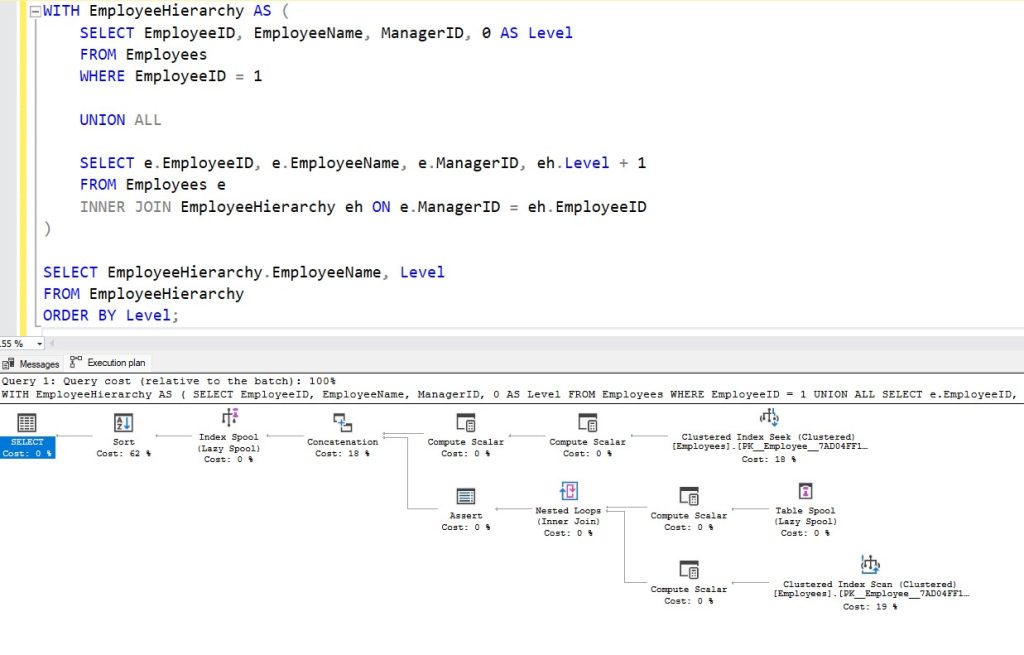

Además de todo lo anteriormente mencionado, cabe destacar la dificultad para interpretar la salida de estos comandos, no solo por la complejidad de su contenido sino, además por la cantidad de registros generados. Fijaos en la siguiente imagen en la que, creo una base de datos nueva, en esa base de datos simplemente creo una tabla, sin ningún registro, no hago nada más y, sin embargo, la salida de DBCC LOG es de 461 filas

Conclusión

El comando DBCC LOG en SQL Server es una herramienta avanzada que, si bien no está documentada oficialmente, puede proporcionar información muy valiosa sobre el estado y las operaciones de una base de datos. Desde la auditoría de transacciones hasta la resolución de problemas complejos, este comando nos permite acceder a detalles intrincados del funcionamiento interno de SQL Server.

Es importante recordar que, debido a su naturaleza no documentada, debemos usar DBCC LOG con precaución y siempre con un propósito claro. En manos de un experto, puede ser la llave para desentrañar problemas difíciles o mejorar la comprensión de cómo se comporta una base de datos bajo determinadas condiciones.

En resumen, aunque DBCC LOG no es una herramienta para el uso cotidiano, su potencial en situaciones específicas lo convierte en un recurso valioso para quienes manejamos SQL Server a un nivel profundo. Si bien su interpretación puede ser compleja, el conocimiento que podemos extraer de este comando es difícilmente igualable, especialmente en contextos donde cada detalle cuenta.